Της Φανής Υβόννης Κυρκιλή,

Πέρα από την υποκειμενική αδικοπρακτική ευθύνη προς αποζημίωση, που αναλύθηκε στο προηγούμενο μέρος, στο νόμο συναντώνται και πολλές περιπτώσεις αντικειμενικής ευθύνης, δηλαδή ανεξάρτητης από υπαιτιότητα. Όταν μάλιστα ούτε και παρανομία απαιτείται, είναι αντικειμενική μη αδικοπρακτική, μεγάλο μέρος της οποίας καταλαμβάνει η λεγόμενη ευθύνη από διακινδύνευση, η οποία υπάρχει στη νομοθεσία μας περιπτωσιολογικά και αποσπασματικά. Υπαγορεύει την ευθύνη αυτού που με τη δραστηριότητά του ή την κατοχή αντικειμένων του σύγχρονου τεχνολογικού πολιτισμού γεννά κινδύνους για τους τρίτους. Για τον καταμερισμό της, συχνά καθιερώνεται εκ του νόμου υποχρεωτική σύναψη σύμβασης ασφάλισης, όπως για την κυκλοφορία αυτοκινήτων.

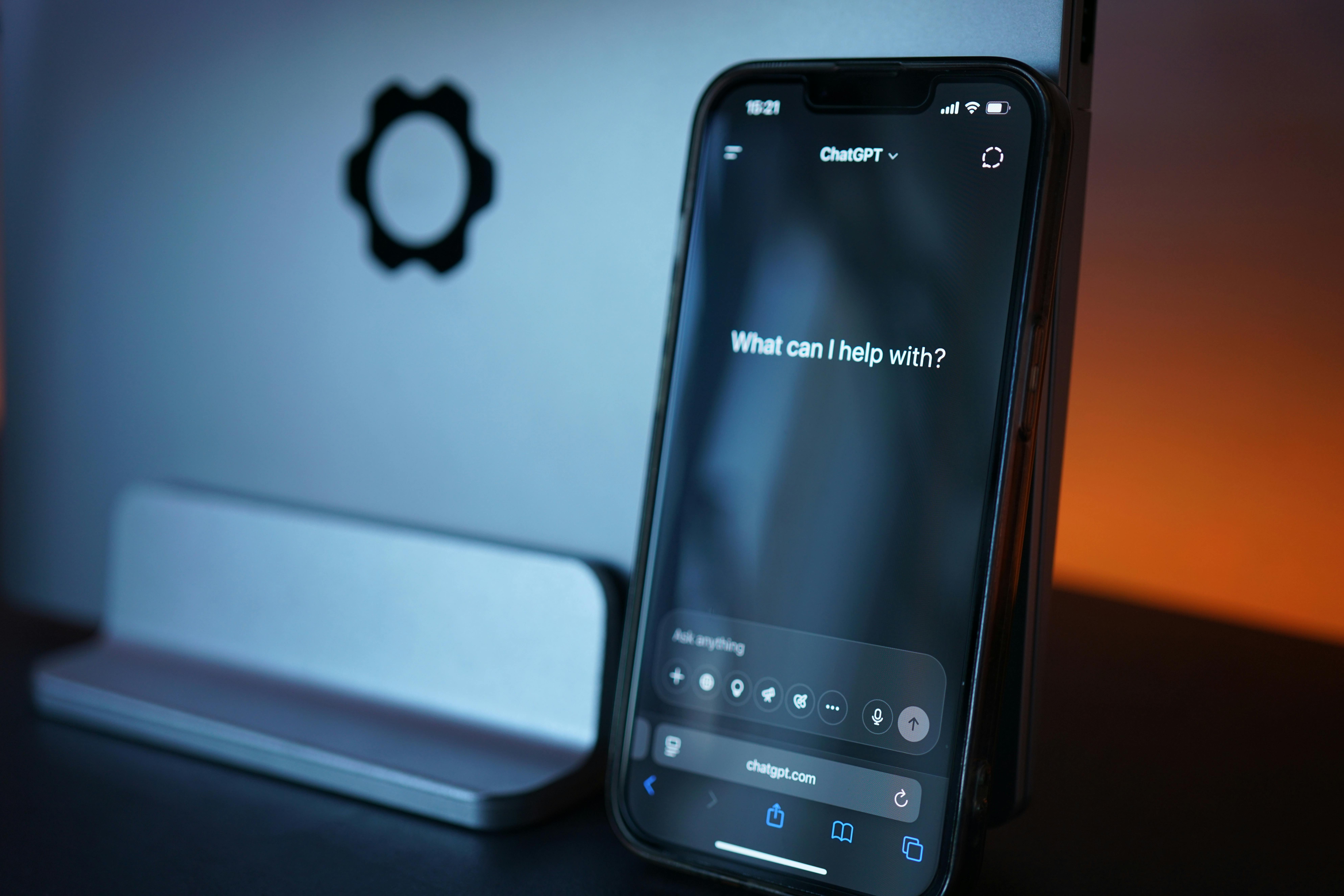

Είναι νομίζω αποδεκτό ότι τα συστήματα AI λόγω της φύσης τους συνιστούν μεγάλης επίδρασης πηγή κινδύνου, η έκθεση στην οποία πολλές φορές είναι αναπόφευκτη. Στον τομέα της ΤΝ, λοιπόν, ίσως προσιδιάζει και ανταποκρίνεται καλύτερα η κατοχύρωση της διακινδύνευσης—είτε με ένα ειδικό νομοθέτημα είτε με την αναλογική εφαρμογή κάποιας από τις ήδη υπάρχουσες διατάξεις, όπως η ευθύνη κατόχου ζώου κι αυτοκινήτου.

Προτείνεται ιδίως για περιοριστικά προβλεπόμενα high-risk ΑΙ systems, όπως αυτόνομα οχήματα, ιατρικά ρομπότ, εφαρμογές πρόβλεψης εγκληματικότητας, που επιφέρουν πιθανότερα σοβαρότερες ζημίες. Ο φορέας της ευθύνης και υπόχρεος προς αποζημίωση θα είναι αυτός που θέτει το προϊόν στην αγορά. Το μειονέκτημα είναι ότι επιβαρύνονται υπερβολικά οι πάροχοι, κάτι που ίσως αποτελέσει ανασταλτικό παράγοντα στις καινοτομίες. Γι’ αυτό βέβαια, συνιστάται η υποχρεωτική ασφάλιση π.χ. αστικής ευθύνης (third-party insurance) ή από ταμεία πρώτης ασφαλιστικής κάλυψης (first-party insurance funds). Πρόκειται για μηχανισμό μέσω του οποίου οι παθόντες-ασφαλισμένοι αποζημιώνονται απευθείας, χωρίς να απαιτείται η απόδειξη του ποιος φταίει και γιατί. Αρκεί η ζημιά να παράχθηκε από ένα καλυπτόμενο ρίσκο.

Στο πλαίσιο της ενωσιακής έννομης τάξης, τα τελευταία χρόνια γίνονται ενθαρρυντικές προσπάθειες ώστε να ρυθμιστεί συνολικά, με ένα ενιαίο και στέρεο νομικό καθεστώς, η λειτουργία της ΤΝ και τα ζητήματα ευθύνης. Κάτι τέτοιο θα ωφελούσε την ασφάλεια δικαίου στην ευρωπαϊκή αγορά, με αύξηση στις επενδύσεις, τον ανταγωνισμό και φυσικά την εμπιστοσύνη των καταναλωτών.

Μία απόπειρα έγινε με την πρόταση Οδηγίας της Ευρωπαϊκής Επιτροπής το 2022 «περί Ευθύνης για την Τεχνητή Νοημοσύνη» (AI Liability Directive), η οποία αποσκοπούσε να λειτουργήσει ως κατευθυντήρια γραμμή, ώστε, έπειτα από προσαρμογή από το κάθε κράτος, να επιτευχθεί ένας ικανοποιητικός βαθμός εναρμόνισης και ίσης μεταχείρισης των θυμάτων.

Δεν εισήγαγε ένα σύστημα αντικειμενικής ευθύνης (strict liability), αλλά αντίθετα υποκειμενικής (fault-based). Επικεντρώθηκε σε αποδεικτικές ελαφρύνσεις, όπως:

-

η αντιστροφή του βάρους απόδειξης: σε περιπτώσεις βλάβης από «υψηλού κινδύνου» συστήματα, ο εναγόμενος θα πρέπει να αποδείξει ότι δεν υπήρξε πταίσμα εκ μέρους του.

-

Καθιέρωσε υποχρέωση διαφάνειας, λογοδοσίας και απαίτηση οι πάροχοι των συστημάτων να δίνουν πρόσβαση σε τεχνικά και λειτουργικά δεδομένα, ώστε να διευκολύνονται οι ζημιωθέντες στη διαδικασία συλλογής και προσκόμισης στοιχείων.

-

Θέσπισε μαχητό τεκμήριο αιτιώδους συνάφειας: όταν ένα σύστημα ΤΝ παραβιάσει υποχρεώσεις συμμόρφωσης, θεωρείται ότι υπάρχει αιτιώδης σύνδεσμος μεταξύ της παράβασης και της ζημιάς αν πληρούνται οι λοιπές αναφερόμενες προϋποθέσεις. Εδώ η Οδηγία συμπληρώνει τον Κανονισμό AI Act, ο οποίος καθορίζει τις σχετικές υποχρεώσεις ανάλογα με τις ταξινομήσεις των συστημάτων βάσει κινδύνου (risk-based approach).

Παρ’ όλα αυτά, πριν λίγους μήνες, το Φεβρουάριο του 2025, η Ευρωπαϊκή Επιτροπή απέσυρε την πρόταση, επικαλούμενη την έλλειψη έγκρισης από Κοινοβούλιο και Συμβούλιο. Η ευρύτερη προσπάθειά της είναι να απλοποιήσει τη νομοθεσία, να αποφύγει την υπερρύθμιση (overregulation) του τομέα της τεχνολογίας και τη γραφειοκρατία. Ωστόσο, η ανάγκη για ένα ακέραιο, εξειδικευμένο, ρεαλιστικό κι αποδοτικό νομικό πλαίσιο αστικής ευθύνης για την τεχνητή νοημοσύνη παραμένει κι αποτελεί το μεγάλο στοίχημα των ημερών μας. Ποιο ρυθμιστικό μοντέλο συμφέρει να υιοθετήσουμε, πιστεύετε;

Κλείνοντας, η τεχνητή νοημοσύνη ήρθε για να μείνει. Και μαζί της φέρνει ένα νέο τύπο προκλήσεων. Η αναλογική εφαρμογή των εν ισχύ διατάξεων και η ερμηνευτική ευελιξία από τα δικαστήρια μπορούν να προσφέρουν πρόσκαιρες λύσεις μέχρι να υπάρξει πλήρης νομοθετική κάλυψη. Διότι πράγματι, αν θέλουμε ένα δίκαιο που προστατεύει ολοκληρωμένα και στοχευμένα τον άνθρωπο, οφείλουμε να αξιολογούμε και να εξελίσσουμε διαρκώς τα νομικά μας εργαλεία!

ΕΝΔΕΙΚΤΙΚΗ ΠΗΓΗ

- Χατζηδάκη Ελένη, Τεχνητή νοημοσύνη και αδικοπρακτική ευθύνη, pergamos.lib.uoa.gr, διαθέσιμο εδώ